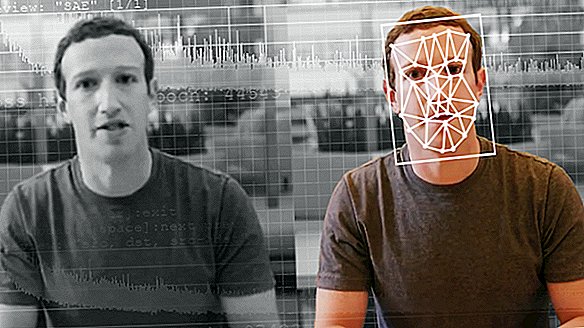

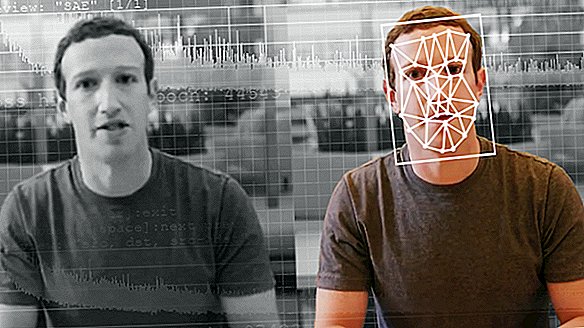

Di tutti i poteri spaventosi di Internet, la sua capacità di ingannare l'ignaro potrebbe essere il più spaventoso. Clickbait, immagini fotografate e false notizie sono alcuni dei peggiori trasgressori, ma negli ultimi anni hanno anche visto la nascita di un nuovo strumento potenzialmente pericoloso noto come intelligenza artificiale di deepfake (AI).

Il termine deepfake si riferisce a video e audio contraffatti, generati dal computer, difficili da distinguere da contenuti originali e inalterati. È filmare ciò che Photoshop è per le immagini.

Come funziona l'IA di deepfake?

Lo strumento si basa su ciò che è noto come reti generative contraddittorie (GAN), una tecnica inventata nel 2014 da Ian Goodfellow, un dottorato di ricerca. studente che ora lavora presso Apple, ha riferito Popular Mechanics.

L'algoritmo GAN coinvolge due IA separati, uno che genera contenuto - diciamo, foto di persone - e un avversario che cerca di indovinare se le immagini sono reali o false, secondo Vox. L'intelligenza artificiale di generazione inizia con quasi nessuna idea di come appaiono le persone, il che significa che il suo partner può facilmente distinguere le foto vere da quelle false. Ma nel tempo, ogni tipo di IA migliora progressivamente e alla fine l'IA che genera inizia a produrre contenuti che sembrano perfettamente realistici.

Esempi di deepfake

I GAN sono strumenti impressionanti e non vengono sempre utilizzati per scopi dannosi. Nel 2018, un dipinto generato dalla GAN che imita lo stile olandese "Old Master" di artisti come il 17 ° secolo Rembrandt van Rijn è stato venduto alla casa d'aste Christie per un incredibile $ 432.500.

Nello stesso anno, i deepfake sono diventati molto diffusi, principalmente attraverso un utente Reddit che si chiamava "deepfakes", ha riferito Vice. La tecnica GAN veniva spesso utilizzata per posizionare i volti di celebrità famose - tra cui Gal Gadot, Maisie Williams e Taylor Swift - sui corpi di attrici di film pornografici.

Altri GAN hanno imparato a scattare una singola immagine di una persona e a creare foto o video alternativi abbastanza realistici di quella persona. Nel 2019, un deepfake potrebbe generare film inquietanti ma realistici della Gioconda che parlano, si muovono e sorridono in diverse posizioni.

Deepfakes può anche alterare il contenuto audio. Come riportato da The Verge all'inizio di quest'anno, la tecnica può aggiungere nuove parole in un video di una persona che parla, facendo sembrare che abbiano detto qualcosa a cui non avevano mai pensato.

La facilità con cui il nuovo strumento può essere implementato ha conseguenze potenzialmente spaventose. Se qualcuno, ovunque, può realizzare film realistici che mostrano una celebrità o un politico che parlano, muovono e dicono parole che non hanno mai detto, gli spettatori sono costretti a diventare più diffidenti nei confronti dei contenuti su Internet. Ad esempio, basta ascoltare l'avvertimento del presidente Obama contro un futuro distopico "esaurito" in questo video di Buzzfeed, creato usando il deepfake del regista Jordan Peele.