I neuroscienziati insegnano ai computer a leggere le parole direttamente dal cervello delle persone.

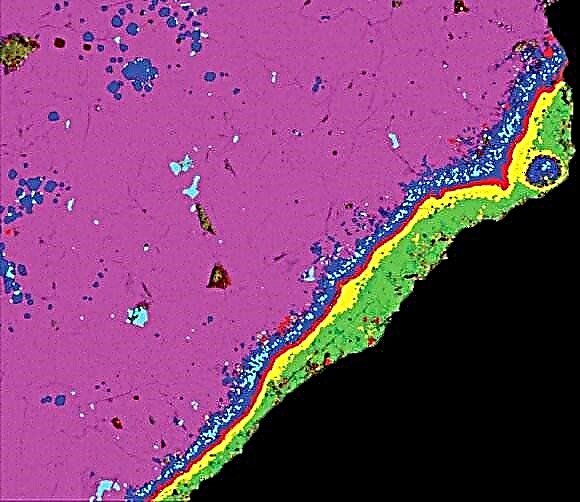

Kelly Servick, scrivendo per Science, ha riferito questa settimana su tre articoli pubblicati sul server di prestampa bioRxiv in cui tre diversi team di ricercatori hanno dimostrato di essere in grado di decodificare il discorso dalle registrazioni degli spari dei neuroni. In ogni studio, gli elettrodi posizionati direttamente sul cervello hanno registrato attività neurale mentre i pazienti sottoposti a chirurgia cerebrale ascoltavano il discorso o leggevano le parole ad alta voce. Quindi, i ricercatori hanno cercato di capire cosa stessero ascoltando o dicendo i pazienti. In ogni caso, i ricercatori sono stati in grado di convertire l'attività elettrica del cervello in file audio almeno in qualche modo intelligibili.

Il primo articolo, pubblicato su bioRxiv il 10 ottobre 2018, descrive un esperimento in cui i ricercatori hanno eseguito registrazioni del discorso a pazienti con epilessia che erano nel mezzo di un intervento chirurgico al cervello. (Le registrazioni neurali prese nell'esperimento dovevano essere molto dettagliate per essere interpretate. E quel livello di dettaglio è disponibile solo nelle rare circostanze in cui un cervello viene esposto all'aria e gli elettrodi vengono posizionati direttamente su di esso, come nella chirurgia del cervello .)

Mentre i pazienti ascoltavano i file audio, i ricercatori hanno registrato neuroni che sparavano nelle parti del cervello dei pazienti che elaborano il suono. Gli scienziati hanno provato una serie di metodi diversi per trasformare i dati di attivazione neuronale in discorso e hanno scoperto che il "deep learning" - in cui un computer cerca di risolvere un problema più o meno senza supervisione - ha funzionato meglio. Quando hanno riprodotto i risultati attraverso un vocoder, che sintetizza voci umane, per un gruppo di 11 ascoltatori, quegli individui sono stati in grado di interpretare correttamente le parole il 75 percento delle volte.

Puoi ascoltare l'audio da questo esperimento qui.

Il secondo documento, pubblicato il 27 novembre 2018, si basava su registrazioni neurali di persone sottoposte a intervento chirurgico per rimuovere i tumori al cervello. Mentre i pazienti leggono ad alta voce parole a sillaba, i ricercatori hanno registrato sia i suoni che escono dalle bocche dei partecipanti sia i neuroni che sparano nelle regioni del cervello che producono la parola. Invece di addestrare profondamente i computer su ciascun paziente, questi ricercatori hanno insegnato a una rete neurale artificiale per convertire le registrazioni neurali in audio, dimostrando che i risultati erano almeno ragionevolmente intelligibili e simili alle registrazioni effettuate dai microfoni. (L'audio di questo esperimento è qui ma deve essere scaricato come file zip.)

Il terzo documento, pubblicato il 9 agosto 2018, si basava sulla registrazione della parte del cervello che converte parole specifiche che una persona decide di parlare in movimenti muscolari. Sebbene nessuna registrazione di questo esperimento sia disponibile online, i ricercatori hanno riferito di essere in grado di ricostruire intere frasi (registrate anche durante un intervento chirurgico al cervello su pazienti con epilessia) e che le persone che hanno ascoltato le frasi sono state in grado di interpretarle correttamente su una scelta multipla test (su 10 scelte) l'83 percento delle volte. Il metodo di quell'esperimento si basava sull'identificazione dei modelli coinvolti nella produzione di singole sillabe, piuttosto che di parole intere.

L'obiettivo di tutti questi esperimenti è quello di rendere un giorno possibile per le persone che hanno perso la capacità di parlare (a causa della sclerosi laterale amiotrofica o condizioni simili) di parlare attraverso un'interfaccia computer-cervello. Tuttavia, la scienza per quella applicazione non è ancora lì.

Interpretare gli schemi neurali di una persona che sta solo immaginando il linguaggio è più complicato che interpretare gli schemi di qualcuno che ascolta o produce discorsi, ha riferito Science. (Tuttavia, gli autori del secondo articolo hanno affermato che è possibile interpretare l'attività cerebrale di qualcuno che immagina di parlare.)

È anche importante tenere presente che si tratta di piccoli studi. Il primo documento si basava sui dati presi da soli cinque pazienti, mentre il secondo esaminava sei pazienti e il terzo solo tre. E nessuna delle registrazioni neurali è durata più di un'ora.

Tuttavia, la scienza si sta muovendo in avanti e i dispositivi di linguaggio artificiale collegati direttamente al cervello sembrano una possibilità reale ad un certo punto lungo la strada.